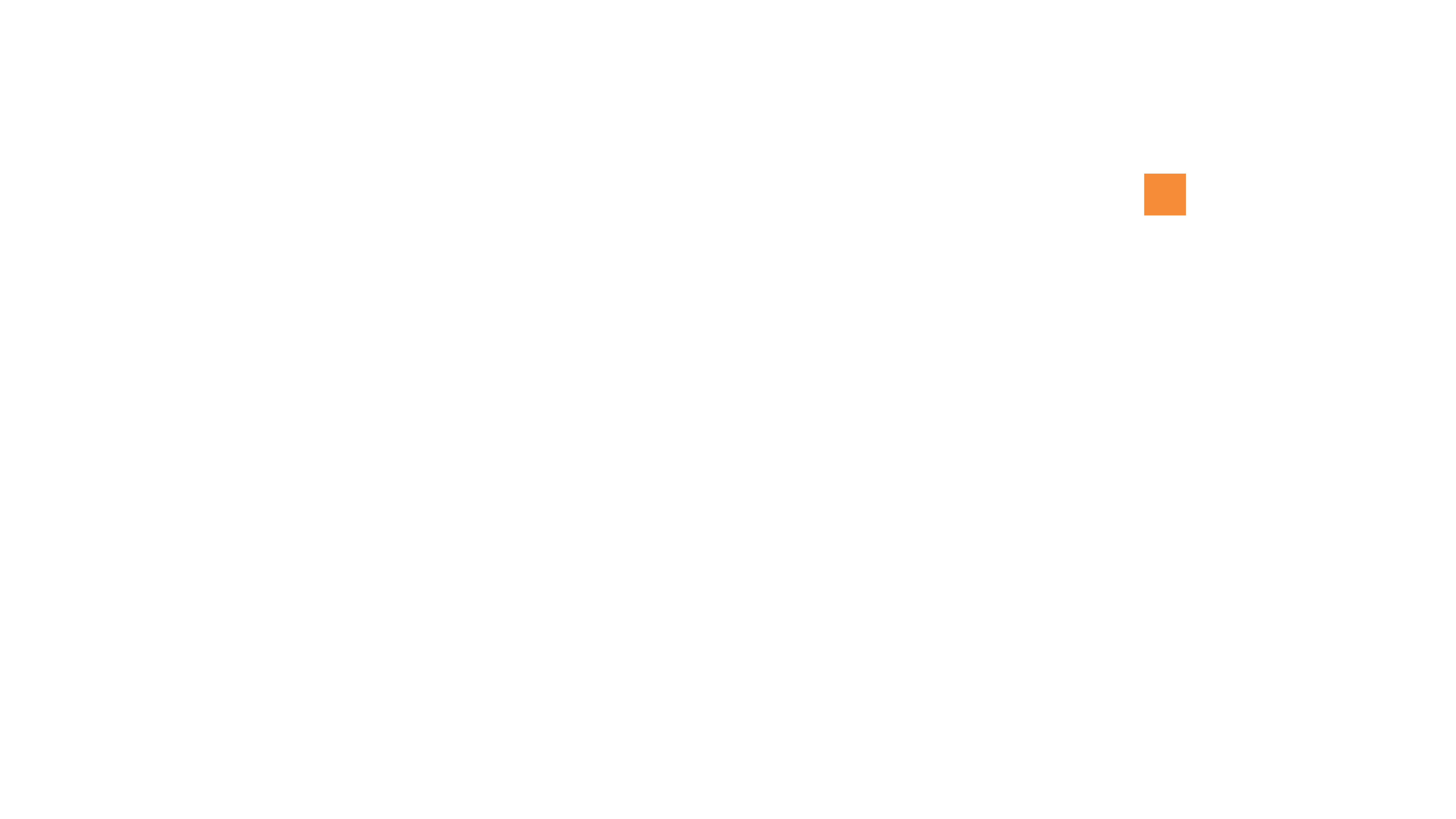

Tener Copilot activo no es lo mismo que tener una adopción madura. Si tu organización dice que ya usa IA en desarrollo, probablemente está cometiendo al menos tres de estos errores sin saberlo.

Si tu organización dice que ya usa IA en los equipos de desarrollo, la primera pregunta no es si es verdad. Es qué significa exactamente eso.

Porque en la mayoría de casos lo que hay es actividad: herramientas activas, ingenieros que las utilizan, tareas que parecen ir más rápido. Y eso puede dar una sensación legítima de progreso. Pero cuando se mira con más detalle, casi siempre aparecen los mismos patrones. Patrones que no son un problema de interés ni de intención, sino de modelo.

Estos son los 6 que vemos con más frecuencia.

1. Confundir uso con madurez

Este es el más extendido y el más difícil de ver desde dentro.

Cómo se manifiesta: hay 40 licencias de Copilot activas, ChatGPT Teams está disponible para todo el mundo, y cuando preguntas «¿estamos usando IA?» la respuesta es un sí rotundo. Pero nadie puede decirte cuántas de esas licencias se usan más de tres veces por semana, en qué tareas concretas, ni qué diferencia están haciendo.

Por qué engaña: porque el volumen de actividad se confunde fácilmente con capacidad. Hay movimiento, luego parece que hay progreso. Pero una organización madura no es la que puede decir que usa IA, es la que puede explicar cómo, dónde y con qué impacto la está utilizando.

Pregunta de diagnóstico: ¿Podrías explicar hoy, con datos, en qué equipos y en qué fases del trabajo la IA está aportando valor real?

2. Pensar que más prompts equivalen a más valor

Cuando los equipos descubren el potencial de la IA generativa, es natural que se centren en sacarle más rendimiento: mejores prompts, más técnicas, más casos de uso. Y eso no está mal. El problema es cuando todo ese esfuerzo se aplica sobre un sistema que no está preparado.

Cómo se manifiesta: ingenieros que generan código a gran velocidad, pero sin estándares compartidos de revisión. Prompts sofisticados que producen resultados que nadie sabe evaluar de forma consistente. Mucha velocidad aparente, pero también más ruido: código que hay que rehacer, inconsistencias entre equipos, decisiones técnicas difíciles de justificar después.

Por qué engaña: porque parece que el equipo está «avanzando» en IA. Y lo está, en la parte táctica. Pero sin una base sólida (arquitectura clara, estándares compartidos, procesos de revisión adaptados), ese esfuerzo solo acelera un sistema que ya era inconsistente.

Pregunta de diagnóstico: ¿Tus equipos están mejorando en usar la herramienta o en integrarla dentro de un modelo de trabajo que la sostenga?

3. Acelerar el código sin tocar nada más

Este es probablemente el error más operativo y el más revelador.

Cómo se manifiesta: la generación de código se ha acelerado, pero el proceso de revisión sigue exactamente igual. Las pull requests se acumulan. El QA se convierte en cuello de botella. El throughput global no mejora tanto como se esperaba, y aparece una frustración difusa: «la IA no está funcionando tanto como pensábamos».

Por qué engaña: porque el síntoma se atribuye a la herramienta («Copilot no es tan bueno») cuando en realidad es un problema de flujo. Has acelerado la entrada del sistema sin adaptar lo que viene después. El cuello de botella no desaparece se desplaza.

Pregunta de diagnóstico: Si hoy tu equipo genera código un 30% más rápido, ¿el resto del sistema (revisión, QA, despliegue) es capaz de absorber esa velocidad?

4. No reservar tiempo para aprender como equipo

La adopción real no ocurre porque los equipos tengan acceso a las herramientas. Ocurre cuando aprenden juntos qué funciona, qué no, y por qué.

Cómo se manifiesta: cada ingeniero evoluciona por su cuenta. Hay personas que sacan un rendimiento enorme y otras que apenas usan la IA. No hay espacios para compartir prácticas, ni para discutir errores, ni para consolidar criterios. El conocimiento queda disperso y es imposible de escalar.

Por qué engaña: porque desde fuera parece que «cada uno va a su ritmo», lo cual suena razonable. Pero en la práctica, sin aprendizaje compartido no hay capacidad colectiva, solo talento individual. Y el talento individual no escala.

Pregunta de diagnóstico: ¿Existe algún mecanismo (sesiones, repositorios, documentación) para que lo que funciona en un equipo se convierta en práctica de toda la organización?

5. No poner gobernanza y calidad en el centro

La velocidad que introduce la IA puede llevar a aceptar resultados sin el nivel de revisión necesario. Y eso es exactamente lo que ocurre cuando no hay criterios claros.

Cómo se manifiesta: se aceptan cambios porque «los ha generado la IA y parece correcto». No hay guardrails que definan qué se puede delegar y qué no. No hay criterios de seguridad adaptados al nuevo flujo. La productividad aparente mejora, pero el riesgo crece en silencio.

Por qué engaña: porque los problemas no aparecen inmediatamente. Aparecen después, en forma de rework, fragilidad, deuda técnica oculta y mantenimiento más caro. Generar más código no es lo mismo que generar mejor software.

Pregunta de diagnóstico: ¿Existen hoy criterios explícitos sobre qué nivel de revisión necesita el código generado con IA según su criticidad?

6. No tener objetivos de negocio

Cuando la adopción de IA se plantea como una iniciativa puramente técnica («vamos a probar Copilot»), se hace muy difícil medir si está funcionando. Y sin medición, con el tiempo es difícil justificar la inversión o priorizar los siguientes pasos.

Cómo se manifiesta: hay uso, hay entusiasmo, hay sensación de que «algo está mejorando». Pero cuando alguien pregunta «¿qué impacto concreto está teniendo la IA en nuestros equipos de desarrollo?», la respuesta depende de la percepción, no de la evidencia.

Por qué engaña: porque el entusiasmo inicial es genuino y la actividad es real. Pero la actividad sin objetivos claros acumula uso, no necesariamente impacto.

Pregunta de diagnóstico: Si mañana tu CEO te pidiera justificar el ROI de la inversión en IA en desarrollo, ¿qué le enseñarías?

Lo que revelan estos errores

Los seis apuntan en la misma dirección: el problema no son las herramientas, sino el sistema donde operan.

La IA no entra en un vacío. Entra en un sistema que ya tiene su arquitectura, sus prácticas, sus procesos de revisión y su cultura. Cuando ese sistema es sólido, la IA lo amplifica. Cuando no lo es, también lo amplifica, pero lo que amplifica es el desorden.

Por eso, el primer paso para resolver cualquiera de estos errores no es cambiar de herramienta ni activar más licencias. Es entender mejor lo que está pasando. Tener una lectura honesta de dónde hay valor real, dónde hay riesgo y qué necesita cambiar para que la adopción sea sostenible.