En esta nueva edición de nuestra serie “Hablemos de…”, ponemos el foco en uno de los meses más intensos que hemos vivido recientemente en el ecosistema de la inteligencia artificial: Abril de 2026.

Durante apenas unas semanas, el mercado ha visto una sucesión de lanzamientos, previews, modelos especializados y actualizaciones relevantes por parte de algunos de los principales actores del sector: OpenAI, Anthropic, Google, Alibaba/Qwen, DeepSeek, Z.AI, Moonshot/Kimi, xAI, MiniMax y Meta, entre otros.

La sensación es clara: ya no estamos ante una evolución lineal de modelos conversacionales. Estamos entrando en una etapa en la que los modelos empiezan a competir por su capacidad de hacer trabajo real: programar, investigar, analizar información, operar herramientas, razonar sobre imágenes, generar voz, coordinar agentes, trabajar durante horas y adaptarse a casos de uso empresariales cada vez más concretos.

En este artículo aterrizamos el panorama actual, analizamos qué ha ocurrido en abril, comparamos los lanzamientos más relevantes y proponemos una mirada estratégica para ayudar a equipos técnicos y no técnicos a tomar mejores decisiones.

Abril de 2026: Una línea de tiempo para entender el tsunami

Nota editorial: aquí incorporaremos una línea de tiempo visual con los principales lanzamientos del mes.

Abril no ha sido simplemente un mes con muchos anuncios. Ha sido un mes que muestra hacia dónde se mueve la industria.

La línea de tiempo podría agruparse así:

- Inicio de abril: fuerte empuje de modelos abiertos y agénticos, con Gemma 4, Qwen3.6-Plus y GLM-5V-Turbo.

- Primera mitad del mes: aparecen modelos orientados a tareas largas, seguridad y verticalización, como GLM-5.1 y Claude Mythos Preview.

- Mediados de abril: llegan apuestas relevantes en robótica, voz, biología, diseño y creatividad, con Gemini Robotics-ER 1.6, Gemini 3.1 Flash TTS, GPT-Rosalind, Claude Opus 4.7 y MiniMax Music 2.6.

- Segunda mitad del mes: se intensifica la carrera de modelos frontier y open-weight con Qwen3.6-35B-A3B, Qwen3.6-27B, Kimi K2.6, DeepSeek V4, ChatGPT Images 2.0, Privacy Filter y GPT-5.5.

La lectura estratégica es importante: el mercado no se está moviendo hacia un único modelo dominante, sino hacia una combinación de modelos con perfiles muy distintos.

Algunos son excelentes para coding. Otros para tareas de investigación. Otros para despliegues locales. Otros para voz, imagen, robótica o privacidad. Y otros para escenarios de bajo coste o alta escalabilidad.

Comparativa estratégica de modelos destacados

Para no perdernos en el ruido, conviene filtrar. Abril trajo muchos lanzamientos, pero no todos tienen el mismo peso estratégico. Si nos quedamos con los modelos que mejor representan el momento actual del mercado, la foto se puede resumir así:

| Modelo | Compañía | En qué destaca | Qué lo diferencia | Ideal para | Punto de cautela |

| GPT-5.5 | OpenAI | Coding, uso de herramientas, análisis, investigación, productividad general | Combina rendimiento alto con un ecosistema muy maduro y una experiencia enterprise muy sólida | Asistentes corporativos, automatización de conocimiento, desarrollo, análisis documental | Coste y dependencia de proveedor |

| Claude Opus 4.7 | Anthropic | Razonamiento, software engineering, tareas largas, research | Muy fuerte en calidad de respuesta, consistencia y trabajo complejo prolongado | Desarrollo de software, análisis profundo, workflows críticos | Puede ser caro para casos de alto volumen |

| Gemma 4 | Google DeepMind | Open model, edge, on-device, eficiencia | Su mayor valor está en despliegue local, latencia y control | Soluciones embebidas, edge AI, privacidad, apps móviles o locales | No siempre sustituye a un frontier model en tareas complejas |

| Qwen3.6 | Alibaba/Qwen | Agentic coding, multimodalidad, contexto largo, flexibilidad | Combina variantes abiertas y hosted con un ritmo de evolución muy agresivo | Equipos técnicos que quieren flexibilidad, control y buen rendimiento/coste | Validar soporte, compliance y madurez para producción |

| DeepSeek V4 | DeepSeek | Gran contexto, eficiencia, buena relación coste/capacidad | Presiona el mercado en coste y rendimiento open-weight | Procesamiento masivo, análisis documental, casos de coste sensible | Requiere madurez técnica y validación propia |

| Kimi K2.6 | Moonshot AI | Multiagente, long-horizon execution, coding, tool use | Apuesta fuerte por agentes coordinados y tareas prolongadas | Laboratorios de IA, prototipos multiagente, automatización avanzada | Complejidad operativa alta |

| GLM-5.1 | Z.AI | Tareas de larga duración, planificación y ejecución por fases | Su narrativa gira en torno a agentes que “trabajan durante horas” | Investigación, agentes largos, tareas iterativas complejas | Riesgo de acumulación de errores si no hay supervisión |

Tras revisar los modelos más relevantes de abril de 2026, el panorama deja una conclusión clara: la competencia ya no se juega solo en quién tiene el modelo más potente, sino en quién ofrece la mejor combinación de capacidad, coste, control, integración y especialización. GPT-5.5 y Claude Opus 4.7 representan la capa premium para organizaciones que buscan fiabilidad, productividad y potencia generalista; Gemma 4, Qwen3.6 y DeepSeek V4 muestran el avance de modelos más abiertos, flexibles y eficientes; mientras que Kimi K2.6 y GLM-5.1 anticipan una nueva etapa centrada en agentes capaces de ejecutar tareas más largas y complejas.

En conjunto, estos lanzamientos confirman que el mercado se está fragmentando: no habrá un único modelo ganador para todos los casos, sino un ecosistema donde la clave será saber elegir y combinar modelos según el objetivo, el riesgo, el volumen de uso y el nivel de gobierno que cada organización necesite.

¿Por qué hacen tanto ruido estos lanzamientos?

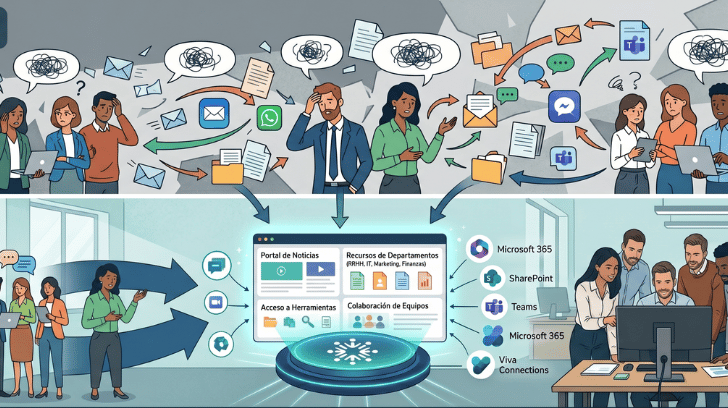

El ruido no viene solo de la cantidad de anuncios, sino de lo que representan: cada modelo promete resolver una preocupación distinta de la empresa. Para los equipos técnicos, aparecen nuevas opciones de coding, contexto largo, coste eficiente o despliegue propio. Para negocio, la pregunta es si esto ayuda a vender más, atender mejor, reducir costes o acelerar procesos. Para dirección, el debate es más estratégico: avanzar demasiado lento puede ser un riesgo, pero adoptar sin criterio también.

Por eso los benchmarks ya no bastan. Un modelo puede destacar en una prueba pública y no ser el más adecuado para una organización si no encaja con sus datos, sus sistemas, sus requisitos de privacidad o su estructura de costes. La madurez consiste en dejar de preguntar qué modelo “gana” y empezar a preguntarse qué modelo resuelve mejor un problema concreto.

El fondo del asunto es que la IA se está especializando. Ya no hablamos de una única herramienta para todo, sino de un ecosistema de modelos para texto, código, voz, imagen, privacidad, edge, ciencia o agentes. El valor estará en saber combinarlos con criterio, gobierno y una visión clara de impacto.

El ruido, en definitiva, no es solo tecnológico. Es estratégico.

Mirada estratégica: cuál usar y para qué

No existe un modelo universalmente mejor. Existe el modelo adecuado para cada contexto.

Para productividad corporativa, asistentes internos, análisis documental o automatización del conocimiento, GPT-5.5 y Claude Opus 4.7 son las opciones más naturales: combinan potencia, madurez e integración. Para desarrollo de software, modernización o agentes técnicos, también destacan, aunque Qwen3.6, DeepSeek V4 y Kimi K2.6 pueden ser alternativas interesantes cuando se busca más flexibilidad, control o eficiencia en coste.

En tareas de alto volumen —clasificar, resumir, extraer información o procesar documentos— no siempre tiene sentido usar el modelo más potente. Aquí ganan peso arquitecturas híbridas, con modelos eficientes para tareas rutinarias y modelos premium solo cuando la complejidad lo justifica.

Cuando entran en juego datos sensibles, privacidad o compliance, la conversación cambia: no basta con elegir un buen modelo. Hay que diseñar una arquitectura segura, con control de acceso, trazabilidad, filtros, despliegues adecuados y gobierno desde el inicio.

La conclusión práctica es clara: la estrategia ganadora no será apostar por un único modelo, sino saber combinarlos. Uno para productividad, otro para volumen, otro para privacidad, otro para agentes y otro para casos especializados.

Cómo debería evaluar una empresa estos modelos

En Raona recomendamos evitar dos extremos: adoptar cada novedad por impulso o bloquear la innovación esperando una estabilidad que no llegará.

El punto de partida debe ser el caso de uso. ¿Queremos reducir tiempos de respuesta? ¿Acelerar revisión de código? ¿Automatizar análisis documental? ¿Mejorar productividad comercial? Cuando el problema está claro, la comparación entre modelos deja de ser abstracta.

Después llega la prueba con datos propios. Los benchmarks públicos orientan, pero no sustituyen una evaluación interna que mida calidad, coste, latencia, facilidad de integración, cumplimiento, aceptación del usuario y esfuerzo de mantenimiento.

Y, sobre todo, hay que pensar en arquitectura. Cada vez tendrá menos sentido desplegar un único modelo para todo. Una solución madura combinará modelos, datos, permisos, observabilidad y gobierno. Especialmente si hablamos de agentes capaces de consultar sistemas, ejecutar acciones o interactuar con clientes.

Consejos para usuarios técnicos y no técnicos

Para usuarios de negocio, la clave no es memorizar nombres de modelos, sino preguntarse qué tarea quieren mejorar. La IA puede ayudar a resumir, comparar, redactar, analizar o explorar ideas, pero sigue siendo necesario revisar, contrastar y aplicar criterio humano. También conviene cuidar los datos: no todo debe introducirse en cualquier herramienta.

Para equipos técnicos, el reto es diseñar soluciones preparadas para cambiar. El modelo líder de hoy puede no serlo mañana, por lo que conviene evitar arquitecturas demasiado acopladas a un proveedor. Evaluar con datos propios, separar la lógica de negocio del modelo, controlar coste y latencia, y definir permisos claros será cada vez más importante.

La autonomía debe crecer paso a paso. Primero la IA asiste, luego propone, después ejecuta tareas de bajo riesgo y, solo cuando existen métricas y controles, puede asumir procesos más críticos.

Conclusión Raona: Menos ruido, más criterio

Abril de 2026 nos deja una imagen clara: la IA avanza a una velocidad vertiginosa, pero el valor no está en perseguir cada novedad. Está en convertir esa evolución en impacto real.

Un modelo puede brillar en benchmarks y no encajar en una organización. Otro puede parecer menos espectacular y resolver mejor una tarea concreta con menor coste, menor riesgo y mayor control.

La pregunta ya no es si la IA generativa va a transformar la forma de trabajar. Eso ya está ocurriendo. La pregunta es cómo hacerlo bien: cómo pasar del experimento al impacto, del chatbot al proceso y del entusiasmo a la adopción responsable.

En Raona ayudamos a las organizaciones a aterrizar este panorama: identificar casos de uso, seleccionar modelos, diseñar arquitecturas seguras, construir agentes, integrar IA en procesos reales y acompañar la adopción con gobierno, medición y formación.

Hablemos de IA. Hablemos de impacto. Hablemos de cómo convertir este tsunami de modelos en una ventaja competitiva real.